- Auteur Lynn Donovan donovan@answers-technology.com.

- Public 2023-12-15 23:51.

- Laatst gewijzigd 2025-01-22 17:35.

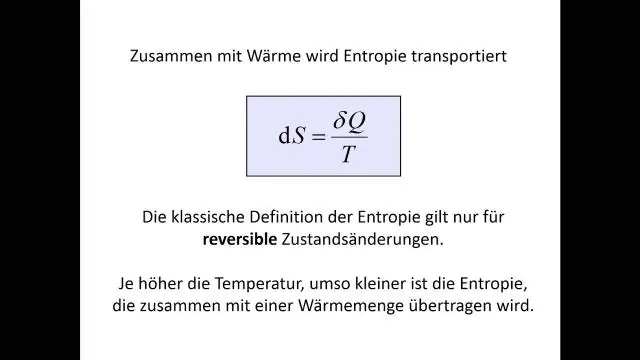

Informatiewinst = hoeveel Entropie we hebben verwijderd, dus

Dit is logisch: hoger Informatiewinst = meer Entropie verwijderd, dat is wat we willen. In het perfecte geval zou elke tak slechts één kleur bevatten na de splitsing, wat nul zou zijn entropie !

Trouwens, wat is informatiewinst en entropie in de beslisboom?

Informatiewinst : De informatiewinst is gebaseerd op de afname van entropie nadat een dataset is gesplitst op een attribuut. Een bouwen beslissingsboom draait allemaal om het vinden van een attribuut dat het hoogste oplevert informatiewinst (d.w.z. de meest homogene takken). Stap 1: Bereken entropie van het doel.

Evenzo, wat is entropie in gegevens? Informatie entropie is de gemiddelde snelheid waarmee informatie wordt geproduceerd door een stochastische bron van gegevens . De maatstaf van informatie entropie geassocieerd met elke mogelijke gegevens waarde is de negatieve logaritme van de kansmassafunctie voor de waarde: waar wordt de verwachting bepaald door de kans.

Wat betekent in dit verband informatiewinst?

Informatiewinst berekent de vermindering in entropie of verrassing van het op de een of andere manier transformeren van een dataset. Informatiewinst is de vermindering van entropie of verrassing door het transformeren van een dataset en wordt vaak gebruikt bij het trainen van beslissingsbomen.

Wat is de definitie van entropie in de beslisboom?

Definitie : Entropie is de maatstaf voor onzuiverheid, wanorde of onzekerheid in een aantal voorbeelden.

Aanbevolen:

Wat is de definitie van entropie in de beslisboom?

Entropie: een beslissingsboom wordt van bovenaf opgebouwd vanuit een rootknooppunt en omvat het partitioneren van de gegevens in subsets die instanties met vergelijkbare waarden (homogeen) bevatten. ID3-algoritme gebruikt entropie om de homogeniteit van een monster te berekenen

Wat is de w3c wat is de Whatwg?

De Web Hypertext Application Technology Working Group (WHATWG) is een gemeenschap van mensen die geïnteresseerd zijn in de ontwikkeling van HTML en aanverwante technologieën. De WHATWG is in 2004 opgericht door personen van Apple Inc., de Mozilla Foundation en Opera Software, toonaangevende leveranciers van webbrowsers

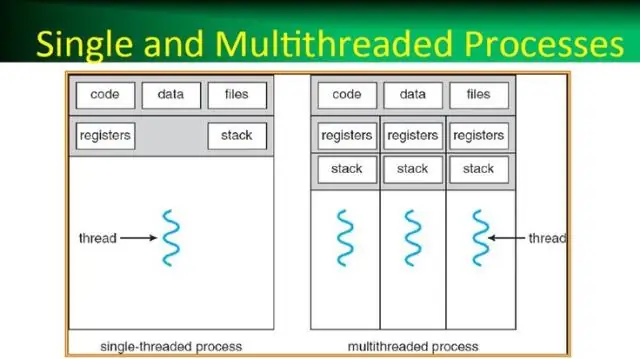

Wat is een proces in een besturingssysteem, wat is een thread in een besturingssysteem?

Een proces, in de eenvoudigste bewoordingen, is een uitvoeringsprogramma. Een of meer threads worden uitgevoerd in de context van het proces. Een thread is de basiseenheid waaraan het besturingssysteem processortijd toewijst. De threadpool wordt voornamelijk gebruikt om het aantal applicatiethreads te verminderen en om de workerthreads te beheren

Wat is entropie in text mining?

Entropie wordt gedefinieerd als: Entropie is de som van de waarschijnlijkheid van elk label maal de logkans van datzelfde label. Hoe kan ik entropie en maximale entropie toepassen op het gebied van text mining?

Wat is Function Point, leg uit wat het belang ervan is Wat zijn functiegeoriënteerde metrieken?

Een Function Point (FP) is een maateenheid om de hoeveelheid bedrijfsfunctionaliteit uit te drukken die een informatiesysteem (als product) aan een gebruiker levert. FP's meten de softwaregrootte. Ze worden algemeen aanvaard als een industriestandaard voor functionele maatvoering