- Auteur Lynn Donovan donovan@answers-technology.com.

- Public 2023-12-15 23:51.

- Laatst gewijzigd 2025-01-22 17:35.

Modeltuning helpt te vergroten de nauwkeurigheid_.

Het doel van parameter: afstemmen is het vinden van de optimale waarde voor elke parameter om de nauwkeurigheid verbeteren van de model -. Om deze parameters af te stemmen, moet u een goed begrip hebben van deze betekenis en hun individuele impact op model -.

Bovendien, hoe kunnen modellen de nauwkeurigheid verbeteren?

Nu bekijken we de bewezen manier om de nauwkeurigheid van een model te verbeteren:

- Voeg meer gegevens toe. Meer data hebben is altijd een goed idee.

- Behandel ontbrekende en uitbijterwaarden.

- Functie Engineering.

- Functie selectie.

- Meerdere algoritmen.

- Algoritme afstemmen.

- Ensemble methoden.

Je kunt je ook afvragen: hoe kunnen we het Random Forest-model verbeteren? Er zijn drie algemene benaderingen voor het verbeteren van een bestaand machine learning-model:

- Gebruik meer (hoge kwaliteit) data en feature engineering.

- Stem de hyperparameters van het algoritme af.

- Probeer verschillende algoritmen.

Als je dit in overweging neemt, wat is dan modeltuning?

Afstemmen is het proces van het maximaliseren van a model's prestaties zonder overfitting of het creëren van een te hoge variantie. Hyperparameters kunnen worden gezien als de "wijzerplaten" of "knoppen" van een machine learning model -. Het kiezen van een geschikte set hyperparameters is cruciaal voor: model - nauwkeurigheid, maar kan rekenkundig uitdagend zijn.

Hoe kan ik een beter model zijn?

- Voeg meer gegevens toe!

- Voeg meer functies toe!

- Functieselectie doen.

- Gebruik regularisatie.

- Bagging is een afkorting voor Bootstrap Aggregation.

- Boosting is een iets gecompliceerder concept en is gebaseerd op het achtereenvolgens trainen van verschillende modellen die elk proberen te leren van de fouten van de voorgaande modellen.

Aanbevolen:

Kan ik de flashopslag op MacBook Pro vergroten?

Officieel is het voor een eindgebruiker niet mogelijk om de opslag na aankoop te upgraden. Echter, zoals voor het eerst gemeld door sitesponsor Other World Computing, is de SSD geïnstalleerd als een verwijderbare module in al deze systemen en is deze vrij eenvoudig te upgraden

Hoe kan ik het bereik van mijn draadloze oplader vergroten?

Grotere (diameter) spoelen zijn dus de enige praktische manier om het bereik te vergroten. Uw bereik is vrijwel beperkt tot één spoeldiameter. Je kunt dit een beetje oprekken door de Q van je spoelen te vergroten en ze te backen / uitboren met ferriet. Verhoog de Q met behulp van Litz-draad en hoge Q-caps

Hoe vind je de nauwkeurigheid van een beslisboom?

Nauwkeurigheid: het aantal juiste voorspellingen gedeeld door het totale aantal gedane voorspellingen. We gaan de meerderheidsklasse die aan een bepaald knooppunt is gekoppeld, voorspellen als True. d.w.z. gebruik het grotere waarde-attribuut van elk knooppunt

Hoe kan ik tekst vergroten voordat ik ga printen?

Vergroot de lettergrootte bij het afdrukken van een webpagina. Klik op 'Bestand' en selecteer 'Afdrukvoorbeeld'. Wijzig het 'Schaal'-percentage om het groter te maken. Hoe het er precies uit komt te zien, ziet u in het afdrukvoorbeeldscherm voordat u gaat printen. Als u tevreden bent, klikt u op 'Afdrukken

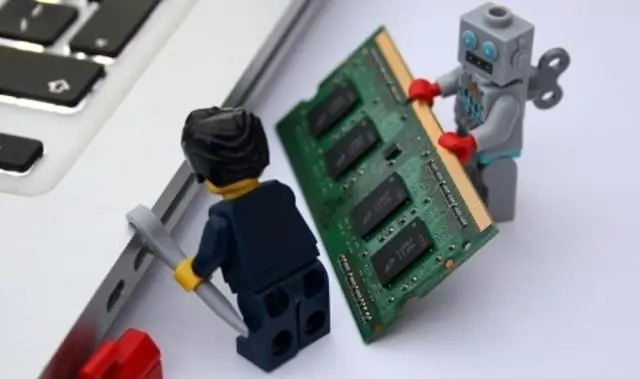

Hoe kan ik het RAM-geheugen van mijn laptop vergroten?

Hoe u het RAM (geheugen) op een laptop kunt upgraden Kijk hoeveel RAM u gebruikt. Ontdek of u kunt upgraden. Open het paneel om uw geheugenbanken te lokaliseren. Aard uzelf om elektrostatische ontlading te voorkomen. Verwijder geheugen indien nodig. Geheugen verwijderen indien nodig